Auf der weniger bekannten Crowdfunding-Plattform Kapipal ist ein Projekt zur Finanzierung des unabhängigen „MTF Lenses LAB“ gestartet. Das Testlabor verspricht Objektivtests, deren Resultate nicht vom Sensor einer Kamera abhängen sollen. Hinter dem Projekt steht offenbar die italienische Fachzeitschrift „Tutti Fotografi“.

Die meisten Testverfahren für Objektive basieren darauf, dass es an eine Kamera montiert wird, mit der dann ein Testbild aufgenommen und ausgewertet wird. Dabei bleibt es nicht aus, dass die verwendete Kamera und speziell ihr Sensor beziehungsweise die interne Bildaufbereitung einen erheblichen Einfluss auf das Ergebnis nimmt.

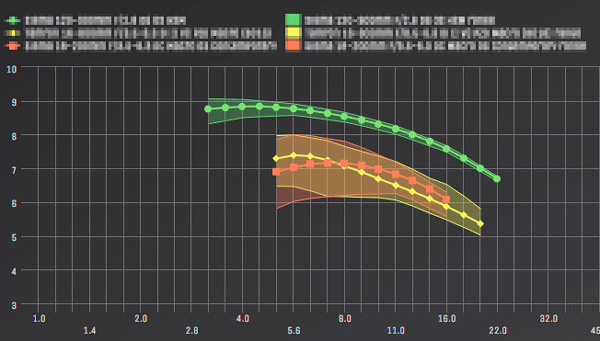

MTF-Lab will auf einfache Weise illustrieren, wie sich ein Objektiv an unterschiedlichen Kameras verhält.

Diesen Einfluss der Kamera auf das Ergebnis von Objektivtests will das MTF Lenses LAB mit einem neu entwickelten Verfahren ausschließen. Wie, darüber schweigen sich die Entwickler aus. Im Ergebnis sollen die Tests die tatsächliche Leistung eines Objektivs ermitteln. Welches praktisch nutzbare Potential sich daraus an Kameras mit unterschiedlichen großen Bildsensoren ergibt, will das MTF Lenses LAB mit einer übersichtlichen Software darstellen.

Derzeit sucht das Entwicklungsteam um Paolo Namias über die Crowdfunding-Plattform Kapipal Investoren, die die Weiterentwicklung der Testverfahren sowie der Auswertungssoftware ermöglichen. Ziel ist es, bis zum 1. Juli 100.000 Euro einzusammeln. Die Objektivtests sollen für jeweils fünf Euro verkauft werden, Unterstützer erhalten je nach Höhe ihres Investments eine bestimmte Anzahl an Testberichten kostenlos.

Gestartet wurde das Crowdfunding-Projekt auf Kapipal von dem Italiener Rodolfo Namias. Namias ist in der Fotografenszene seines Heimatlands nicht ganz unbekannt. So verantwortet er etwa das italienische Fotomagazin „Tutti Fotografi“ als Chefredakteur, das Impressum der Internetseite fotografia.it nennt ihn als Herausgeber. Über diese Internetseite vermarktet Tutti Fotografi übrigens bereits jetzt seine Labortests – für fünf Euro pro Testbericht.

Weitere Informationen:

Crowdfounding-Projekt The ultimate Test of Lenses auf Kapipal.

(Martin Vieten)

Interessant wären diese

Interessant wären diese Ergebnisse durchaus. Ob sie in der Praxis relevant sind, bezweifle ich aber. Sensoren sind auch auf Objektive bzw. auf Bajonett-Besonderheiten speziell abgestimmt. Das Mikrolinsen-Design eines E-Mount-Sensors ist definitiv ein anderes als bei einem Sensor für Spiegelreflexkameras. Was immer derartige Tests also ergeben, man wird es wohl nicht 1:1 auf den Praxiseinsatz übertragen können.

Habe den Artikel

leider nicht über Google gefunden. Ich denke, ich schreibe mal an die Redaktion der Zeitschrift.

QED

Sony und Nikon …

Auch Ihnen ganz herzlichen Dank!

Sie haben mir wichtige Aspekte genannnt, um RAW-Konverter besser zu verstehen. Bei meinem Workflow vermute ich jetzt, wird von unterschiedlicher Seite wahrscheinlich noch viel mehr “herumgedoktort”. Ich habe LR 5.x. Das Programm hat noch kein Kameraprofil für meine Canon M3 implementiert. Um damit trotzdem arbeiten zu können, konvertiere ich die RAW-Dateien zuvor mit Adobes DNG-Konverter zu DNG-Dateien. Dann erst lade ich sie in LR. Mit meiner Nikon D7100 brauche ich nicht so verfahren, sie ist LR bekannt. Da aber NEF-Dateien um ~ 10% größer als DNG-Dateien sind, konvertiere ich beim Import ebenfalls zu DNG. Jetzt stelle ich mir vor, dass Adobe bei der Konvertierung ins DNG-Format vielleicht auch gar nicht so unschuldig verfährt, sondern wo möglich auch noch am Bildeindruck herumverbessert. Könnte das sein? Oder ist DNG absolut unverdächtig?

Sie haben sich

Ihre Frage grad selbst beantwortet … Stichwort 10% kleiner als NEF.

DNG

Ich denke, beim DNG kommt’s auch auf den Einzelfall an. DNG hat ja die Möglichkeit, Kameraprofile im DNG einzubetten, damit eben auch Software, die die Kamera selbst nicht kennt, prinzipiell in die Lage versetzt wird, damit etwas anzufangen. (Es gibt aber auch Raw-Konverter, die verweigern aber auch bei so erstellen DNGs von Kameras, die sie nicht kennen, den Dienst, weil sie nur auf die eigenen Profile zurückgreifen, und wenn keins existiert, die Bearbeitung ablehnen.) Wenn nun eine Software ein DNG mit Profil bekommt, während sie selbst auch ein eigenes Profil für die Kamera hat, muss sie sich natürlich entscheiden, welches sie verwendet – sollten die Profile aus welchem Grund auch immer unterschiedliche sein, besteht da tatsächlich die theoretische Möglichkeit, dass ein selbsterzeugtes DNG nachher andere Ergebnisse produziert als das Original-Raw aus der Kamera. Ich kenne mich mit der Adobe-Software aber zuwenig aus, um sagen zu können, ob sowas dort der Fall sein kann. (Etwas anderes als das passiert nach meinem Dafürhaltgen beim Erstellen eines DNGs jedenfalls eher nicht.)

Dass die Art und Weise,

wie der Sensor mit dem einfallenden Licht umgeht, einen erheblichen Einfluss auf das messbare Ergebnis hat, dürfte ausser Frage stehen. Canon hat mir auf Anfrage gesagt, dass bei RAW-Aufnahmen überhaupt nichts in der Kamera manipuliert würde. Ich habe es mir auch nicht anders vorstellen können und hoffe, es stimmt wirklich. Und das dürfte dann auch auf Nikon zutreffen.

Dennoch haben die RAW-Bilder meiner Nikon und meiner Canon einen gänzlich unterschiedlichen Charakter. Canon kommt kontrastreicher und mit kräftigeren Farben als Nikon. Wenn ich Manipulation ausschließe, dann wird das wohl daher kommen, dass der Nikon-Sony-Chip anders mit dem Licht umgeht als der Canon-Chip.

Wenn die Italiener dem Einfluss des Sensors entgehen wollen, dann würde es eigentlich schon genügen, das Testobjektiv auf die optische Bank zu spannen und hinten immer das gleiche digitale Rückteil anzusetzen. Eine reine Softwarelösung ohne Speichermedium halte ich für nicht machbar.

RAW

[quote=saumhuhn]Canon hat mir auf Anfrage gesagt, dass bei RAW-Aufnahmen überhaupt nichts in der Kamera manipuliert würde.[/quote]

Da gab es entweder ein Kommunikationsproblem oder Canon sagt nicht die Wahrheit.

Lesen Sie zum Beispiel mal den Artikel in der Zeitschrift inVision, Ausgabe 2/2014, Seiten 14-17. Der ist auf Deutsch und auch für den Laien verständlich. Danach wissen Sie das und warum RAW nicht Roh bedeutet.

OhWeh

Unterschiedliche Sensoren…

… haben mitunter schon auch unterschiedliche Charakteristiken. U.a. deswegen beinhaltet ein Raw-Konverter mehr als nur den Algorithmus zur Bayer-Interpolation (Demosaicing), sonst wäre die Sache einfach und jeder Raw-Konverter könnte jede Kamera bedienen, sofern ihm nur die Anordnung der Daten in der Raw-Datei bekannt wäre. Tatsächlich braucht er aber für jede Kamera ein Profil, das bestimmt, welche Basisverarbeitung bei einer bestimmten Kamera stattfindet. Das ist in jedem Fall eine kameraspezifische Tonwertkurve einschließlich der Grund-Farbabstimmung, das sind aber unter Umständen auch noch weitergehende Maßnahmen wie z.B. eine Basis-Schärfung und eine Grund-Entrauschung, alles kameraspezifisch. Schärferegler und Entrauschungsregler im Raw-Konverter auf “null” oder “neutral” zu lassen garantiert deswegen mitnichten, dass damit nicht doch bereits irgendwo geschärft oder entrauscht worden wäre.

Das bedeutet zum einen, dass mit einer konkreten Canon und einer konkreten Nikon theoretisch durchaus auch wegen der Unterschiedlichkeit der Sensoren unterschiedlich aussehende Bilder aus dem Konverter kommen könnten – oder wegen unterschiedlicher Vorarbeiten der Kamera im Raw, die tatsächlich auch nicht ausgeschlossen werden können.

Das bedeutet aber zum anderen, dass theoretisch auch bei zwei verschiedenen Kameras, die identische Sensoren haben und die kameraintern beide auch nichts Unterschiedliches an den Rohdaten herumdoktern, aus einem konkreten Raw-Konverter mit denselben Parametern zwei unterschiedliche JPEGs entstehen können, einfach weil die Profile der beiden Kameras womöglich unterschiedliche Abstimmungen beinhalten.

Grüße,

Robert

Raw

[quote=saumhuhn]Dennoch haben die RAW-Bilder meiner Nikon und meiner Canon einen gänzlich unterschiedlichen Charakter. Canon kommt kontrastreicher und mit kräftigeren Farben als Nikon. [/quote]Das Raw kommt mit gar keinen Farben. Erst durch die “Entwicklung” mit dem Raw-Konverter wird erst ein Bild aus der Raw-Datei. [quote=saumhuhn]Wenn ich Manipulation ausschließe, dann wird das wohl daher kommen, dass der Nikon-Sony-Chip anders mit dem Licht umgeht als der Canon-Chip.[/quote]Oder dass der Raw-Konverter die eine Datei anders konvertiert, anders konvertieren muss, als die andere.

Crowdfunding

ins Blaue hinein …

So sinnvoll wie ein Bremsentest ohne Auto…

Was nützt mir ein Ergebnis, das ich selbst nicht umsetzen kann? MEINE Objektive sind auf MEIN System mehr oder weniger gut abgestimmt, Aufnahmen ohne Sensor sind mir nicht möglich und adaptieren vermeintlich besserer Fremdprodukte scheitert an mechanischen und elektronischen Unverträglichkeiten. Also, was soll das Ganze? Und dann auch noch für 5€ pro Test, wo doch Bezahlinhalte im Web schon bei deutlich geringere Summen kaum akzeptiert werden?

Wie geil

Dinge, die die Welt nicht braucht!

Als nächstes dann ein Vergleichstest zum Verbrauch aktueller Autos mit Stahlreifen auf Schienen im Vakuum?

Was soll ich denn mit einem Objektiv ohne Kamera?

Oder hat VW mit seiner “Prüfstand-Optimierung” dann doch nur den Trend der Zeit erkannt statt “geschummelt”?

unabhängige Tests bieten bereits

die Seiten www.lenscore.org und www.senscore.org

Die Seite lenscore zeigt diverse Testwerte von Optiken an einem Sensor mit 200Mpix getestet.

Made in Switzerland

Wow

Aktueller Spendenstand: 20 Euro von 100.000 Euro. Hahaha …

Sinn

Was ich lustig finde in der “Kritik” des Testansatzes, ist der Umstand, dass anscheinend niemand jemals beabsichtigt, seine Obektive an einer anderen, neueren, evtl. höher auflösenden Kamera einzusetzen als der, die er aktuell verwendet.

Was mir bei der Beschreibung des Testverfahrens fehlt, ist dagegen ein Hinweis auf die unterschiedlichen Glas-Filterstapel auf dem Sensor, die für jedes System eine definierte Dicke haben, meist um die 2mm, in Einzelfällen aber auch mehr (Four Thirds: 4mm), und die in Objektivrechnungen genauso berücksichtigt werden müssen wie in Objektivtests auf der optischen Bank für das jeweilige System. Bei Lensrentals, wo solche Tests bereits regelmäßig stattfinden, was der Entwickler des diskutierten Verfahrens noch nicht mitbekommen zu haben scheint, ist das der Fall…

Spannende Idee mit großen technischen Hürden

Die Idee ein Objektiv ohne Kamera zu vermessen ist in der Entwicklung von eben diesen und in der Produktion Tagesgeschäft.

Für den Anwender bringen aber diese Informationen nur bedingt etwas. Hinter dem Objektiv und dem Detektor finden sich noch mehrere optisch wirksame Elemente (Mikrolinsen, IR-Sperrfilter, Farbfilter, Tiefpassfilter, etc.) Für den Anwender ist genau diese Kombination aus Objektiv und Kamera (mit seinen optischen Komponenten) die letztendlich das Bild ausmachen.

Aussagen aus einer “Nur Objektiv”-Messung auf eine “Kamera mit Objektiv” Kombination sind also technisch gesehen schwierig, da man sehr viele Parameter simulieren müsste. Ob dies hier geschieht weiß man aktuell nicht da sämtliche technische Aussagen fehlen.

Abgesehen davon bezweifle ich das Geschäftsmodell, aber das ist ein ganz anderes Thema.

Spannend allein

ist die Chuzpe des Unterfangens … :-)))

Quatsch

wenn nicht offen gelegt wird wie die Ergebnisse erzielt werden, also die Methode nicht bekannt ist, dann sind die Ergebnisse wertlos. So einfach ist das.