Panasonic arbeitet derzeit an einem MOS-Sensor mit besonders hohem Dynamikbereich. Er soll dereinst in Auto- und Sicherheitssystemen zum Einsatz kommen; eignet sich allerdings nicht für die kamerainterne HDR-Fotografie. Dafür gibt es andere Ansätze:

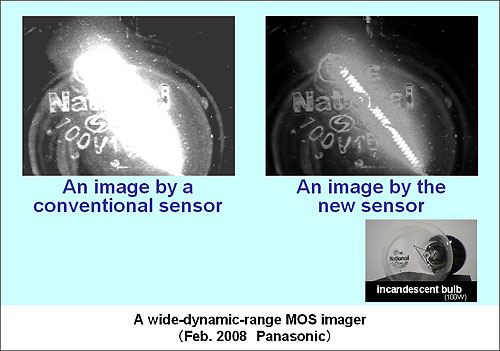

Laut Panasonic soll der MOS-Sensor einen Dynamikumfang von 140 dB erfassen können und damit in etwa das Helligkeits-Sehvermögen des menschlichen Auges erreichen. Herkömmliche Bildsensoren erfassen um 50-60 dB gleich 8-10 Blendenstufen

Die Besonderheit sein nun, so Panasonic, dass der MOS mehrere Aufnahmen mit unterschiedlicher Belichtungszeit komprimiert in jedem Pixel ablegen könne – was die Systemkosten drastisch reduziere, da ein externer Bildspeicher überflüssig werde. Da der Hersteller von hohen möglichen Bildraten und Videoaufnahmen spricht, ist davon auszugehen, dass die einzelne Belichtung mit extrem kurzer Belichtungszeit erfolgt – nur so lassen sich mehrere Belichtungsvarianten in Sekundenbruchteilen aufzeichnen, die auch für Filme tauglich sind.

Panasonic will die Technologie in die nächste Generation der Maicovicon-Serie einfließen lassen und sieht mögliche Einsatzgebiete im Automobil- und Überwachungsbereich.

Bei Panasonics Neuentwicklung handelt es sich um einen MOS-Helligkeitssensor, der nicht mit einem CMOS-Bildsensor gleichzusetzen ist. Eine mögliche Verwendung als Bildsensor in Kameras liegt in weiter Ferne; der Nutzen ist fraglich. Dafür ist der Helligkeitssensor auch offensichtlich nicht entwickelt: Hohe Integration und Kostenaspekte stehen im Vordergrund, nicht das bessere Bild.

Abgesehen davon wird eine kamerainterne Freihand-HDR-Aufnahme, die auf Mehrfachbelichtung setzt, nicht so ohne Weiteres funktionieren. Die Belichtungszeiten müssen alle extrem kurz, die Bildfolge sehr schnell sein, um scharfe, deckungsgleiche Fotos zu erhalten. Kurze Belichtungszeit wiederum impliziert wenig Zeichnung in den Schattenbereichen.

Denkbar wäre eine Abwandlung von Samsungs recht cleverer Software-Bildstabilisierung Fast-ASR, die sich zum Beispiel in der NV30 findet: „Im Fast-ASR-Modus macht die Kamera automatisch zwei Fotos mit gleichen ISO- und Blendenwerten. Eine Aufnahme mit schneller Verschlusszeit liefert dabei die Schärfeinformation, ein zweites Bild mit langer Zeit sorgt für die Farbinformation. Die beiden Aufnahmen werden dann von der Kamerasoftware zu einem perfekten Ergebnis verknüpft.“

Nach demselben Prinzip könnte man auch zwei Aufnahmen mit unterschiedlicher Empfindlichkeit für die Lichter- und Schattenzeichnung nutzen und zu einer HDR-Aufnahme kombinieren. Aber sehr schnell muss es gehen, sonst ist es unscharf und nicht deckungsgleich.

Einen ganz anderen Weg geht Fujifilm. Das Unternehmen packt Pixelpaare mit unterschiedlicher Empfindlichkeit auf einen Sensor und erreicht so mit einer Aufnahme einen deutlich höheren Dynamikumfang als normale Bildsensoren zu liefern im Stande sind. Siehe dazu: HDR-Sensoren und HDR-Fotografie; Teil 1

(thoMas)

enfuse

Freihändig geht bereits, und das sogar bei sphärischen Panoramen! Bruno Postle hat dazu für hugin ein sehr interessantes Tutorial geschrieben (http://hugin.sourceforge.net/tutorials/enfuse-360/en.shtml). Das neue tool enfuse bietet dabei einen gegenüber dem auch mit Software wie Photomatix bisher üblichen Weg eine wesentlich vereinfachte und angenehmere Abbildung hoher Kontrast- bzw. Dynamikumfänge. Mehr unter http://wiki.panotools.org/Enfuse

Den Begriff HDR-Sensoren halte ich übrigens für ziemlich irreführend. Eine Fuji S5 bringt in einer Aufnahme immer noch weniger rüber als ein guter Farbnegativ-Film, und auch da wird der Begriff 16bit-workflow verwendet. Echtes HDR (siehe Dateiformat .hdr) geht in ganz andere Bereiche.

HDR bei der Aufnahme (single shot/pass) geht irgendwo hier los:

http://www.spheron.com/en/PI_spherocamhdr_overview/PI_spherocamhdr_overview.php

Naja, ist damit eine

Billigknipse mit fester Belichtungszeit auch Filmverbrennerkamera genannt dann eine HDR-Kamera nur weil man damit den extrem hohen Dynamic Range von Negativ-Filmen ausreizen kann?

Welcher Entwicklungsprozess bis zum Abzug nutzt die 20 Blendenstufen Dynamic Range von Negativ-Filmen aus?

Warum sieht ein Bild aus einer Kamera die bei JPEG den DR mit typ. 8 Blendenstufen beschneidet vom DR im Vergleich zu einem Abzug okay aus und bietet idR. sogar mehr Details in Schattenbereichen und sogar Lichtern soweit es sich um einen Sensor handelt der einen komfortablen Dynamic Range anbietet?

Warum sagt man bei Aufnahmen mit HDR-Dynamikumfang und Tonwertfehler, welche im Rahmen der Interpolation in der Kamera oder außerhalb der Kamera passiert sind “Mann, sieht das besch…aus?” während das JPEG mit gerademal 8 Blendenstufen und korrekten Tonwerten und va. ohne Posterization begeistern kann?

Warum muß man etwas von Tonwertkorrekturen verstehen um wirklich gute HDR-Aufnahmen anfertigen zu können?

Warum hat Negativ-Film neben dem Komfort des großen Dynamikumfanges eigentlich nur den Vorteil des nichtlinearen Tonwertkurvenverlaufes im Bereich der Lichter?

“Die Sendung mit der Maus”, Löwenzahn, “1, 2 oder 3?”…verpaßt?!

Hah! Apropos “Löwenzahn”…da kommt mir doch einen Idee, hmmmm…

20?

20 Blendenstufen?

Woher stammt diese Zahl? Für welche Filme soll sie gelten? Schwarz/weiß Negativfilme mit ISO25?

Die mir bekannten Werte für handelsübliche Farbnegativfilme liegen irgendwo bei 12-14 Blendenstufen.

Das ist also etwa der Bereich, den eine S5pro abdecken kann.

12-14 Blendenstufen, die bei der Entwicklung zu ca 5 Blendenstufen auf dem Papier komprimiert werden.

Ob es hier wohl um

Night Vision Sensoren geht?!

Neet schlecht…