Panasonic gibt die Entwicklung eines Bildsensors bekannt, der mit einer „Global Shutter“-Funktion ausgestattet ist. Dadurch werden Filmaufnahmen von sich schnell bewegenden Objekten möglich, ohne dass diese verzerrt dargestellt werden. Aber auch Fotokameras könnten von der Entwicklung profitieren.

Videofilmer schlagen sich seit Jahrzehnten mit einem Problem herum: Das einzelne Filmbild wird nicht auf einen Schlag belichtet, sondern zeilenweise – ganz gleich ob mit einem rotierenden Verschluss auf Film belichtet wird oder ein CMOS-Sensor aufnimmt. Bewegt sich nun ein Objekt schnell durchs Bild, wird es verzerrt aufgenommen. Das Problem, der „Rolling Shutter“-Effekt, lässt sich zwar minimieren, etwa durch eine kürzere Verschlusszeit, aber nicht ganz aus der Welt schaffen.

Panasonic hat nun die Entwicklung eines CMOS-Sensors bekannt gegeben, der eine „Global Shutter“-Funktion aufweist. Das heißt: Alle Sensorzellen werden gleichzeitig an- und ausgeschaltet und sodann ausgelesen. Dieses Verfahren zur Vermeidung des „Rolling Shutter“-Effekts ist zwar nicht ganz neu, hatte bislang jedoch mit anderen Problemen zu kämpfen – etwa einer verringerten Farbsättigung oder verstärktem Bildrauschen.

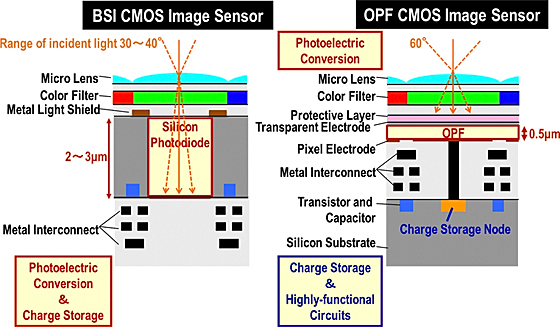

BSI- und OPF-Sensor im Vergleich.

Die bei OPF deutlich geringere Tiefe der lichtempfindlichen Schicht bringt einige Vorteile.

Kernstück bei der Entwicklung von Panasonic ist eine transparente organische Substanz, die die Funktion der herkömmlichen Photodioden übernimmt. Dieser von Fujifilm entwickelte „organic photoconductive film“ (OPF) wird als hauchdünne Schicht auf der Verdrahtung des Sensors aufgetragen, also ähnlich wie beim BSI-Design.

Beim OPF verringert sich die Eindringtiefe des Lichts auf 0,5 µm gegenüber zwei bis drei µm beim BSI-Design. Das bringt eine Reihe von Vorteilen mit sich, nicht nur für Filmaufnahmen:

- Die Basisempfindlichkeit des Sensors steigt um den Faktor 1,2.

- Während beim BSI-Design das einfallende Licht höchstens um 30° bis 40° von der Senkrechten abweichen darf, verkraftet OPF eine Abweichung von bis zu 60°. Das ermöglicht eine höhere Lichtausbeute und hilft laut Panasonic zudem, Farbfehler zu vermeiden.

Der größte Vorteil ergibt sich allerdings daraus, dass beim OPF-Sensor die photoelektrische Schicht und die Schaltkreise zum Speichern der elektrischen Ladung völlig unabhängig voneinander sind. Das ermöglich es, jedes Pixel einzeln anzusteuern und damit auch ein- und auszuschalten. Werden alle Pixel eines Sensors gleichzeitig aktiviert beziehungsweise deaktivert, ergibt sich der Global Shutter.

Allerdings ermöglicht es die Technologie auch, die Belichtungszeit für jedes Pixel einzeln zu steuern. Das wiederum eröffnet neue Möglichkeiten für die Fotografie. So könnte etwa der Effekt von flackerndem Licht auf die Aufnahme eliminiert werden. In Verbindung mit einer Objekterkennung wäre es sogar möglich, ein sich schnell bewegendes Objekt innerhalb eines Bildes mit einer kurzen Zeit und entsprechend erhöhter Empfindlichkeit zu belichten, während der statische Hintergrund bei niedriger Empfindlichkeit länger belichtet wird – was wiederum störendes Bildrauschen auf einen kleinen Bildbereich beschränken würde. Ebenso ließe sich durch einzeln ansteuerbare Pixel der Dynamikbereich extrem erhöhen. Dazu würden sehr helle Bildpartien einfach kürzer belichtet als die Schattenpartien, Belichtungsreihen für HDR-Bilder wären nicht mehr nötig.

(Redaktion photoscala)

Shut up …

… and take my money 😀 In die GH5 einbauen und wohin darf ich bitte das Geld hin überweisen?

Klingt alles SEHR vielversprechend und geht Mal in die richtige Richtung.

Ein Erinnerungsfoto

vom Narrenschiff … bevor es sinkt. :-)))

LUMIX DMC-GX9

Das ist eine sehr gute Nachricht. Hoffentlich kommt die Entwicklung sehr bald zur Serienreife. Eine DMC-GX9 mit diesem Sensor würde mir sehr gut gefallen! Ich bin GF1 Nutzer, sozusagen ein MFTler der ersten Stunde und sehr zufrieden mit diesem System. Die Daten der DMC-GX8 sprechen ja schon für sich. Zudem bei diesem Modell die Farbprobleme bei Naturaufnahmen nun im Griff sind. Eine Weiterentwicklung, wie sie oben beschrieben ist, wäre da nochmals ein großer Schritt in Richtung perfekte Kamera.

Nicht nur MF

sondern auch GF rückt wieder in greifbare, weil bezahlbare Nähe … eine absehbare Wohltat, den Ödnissen digitaler Kreativtiefebenen aller zu Kurzgekommenen und zu Kleingeratenen entfliehen zu können.

Zu viel Korn

hinter der Kimme …!? :-)))

Global Shutter

Global Shutter Sensoren in CMOS-Technik gibt es ja schon seit einiger Zeit bis hin zu Kleinbildformat und 20 MP. Jedoch in größeren Formaten (fast) nur für den Industriebereich, wo man die verringerte Bildqualität gegenüber Rolling Shutter wegen der hohe Framerates (Beispiel: 300fps bei 12 MP im APS-Format) akzeptiert.

Ich bin gespannt, was zu erst kommen wird: Herkömmliche CMOS-GlobalShutter-Sensoren für den Consumerbereich z.B. im FT-Format (vollwertiger elektronischer Verschluss ohne Nachteile), oder organische Sensoren z.B. im Bereich Automotive und Überwachung (hoher Dynamikumfang vorteilhaft).

Bei Bildsensoren tut sich auf jeden Fall sehr viel, da kommt einiges auf uns zu.

OhWeh

Ist doch interessant

dass Panasonic einen so zukunftsträchtiges Projekt zusammen mit Fuji angeht, obwohl es derzeit ja Sony-Sensoren verbaut … Als Kodak dereinst Canon belieferte und dann unter Druck setzte, hat Canon eigene Sensoren entwickelt. Als Canon digital dominierte, wurden sie bei der Sensorfertigunbg von Sony abgehängt. Als Sony …

Nicht ganz korrekt …

Kodak als nicht-japanisches Unternehmen war von Beginn zum Scheitern verurteilt, genauso wie die verbliebene deutsche Foto-Industrie (Foto-Apperate erzeugt nur mehr Leica) nur mehr in Nischenmärken bestehen kann und aus dem selben Grund warum Samsung seine APS-C Sensor-Fertigung schliessen musste, bevor sie überhaupt wirklich bekannt wurde.

Die Foto-Branche ist Japan dominiert und leider wird im deutsch-sprachigem Raum VIEL zu wenig über die Verflechtungen berichtet (damit meine ich auch Photoscala) als z.B. in englischen Medien.

Gerade erst hat Sony in seiner brandneuen “G-Master” Objektive neue Technologien für die Produktion der asphärische Elemente präsentiert, die Panasonic als weltweit größter Erzeuger asphärischer Linsen schon längst im Programm hat (und mit Sicherheit sich patentieren lies).

Eine Hand wäscht die andere … 😉

die Aufzählung der Vorteile ist nicht ganz vollständig,

durch die unabhängige Erfassung von belichteter Fläche und der Verrechnung derselben, kann auch erkannt werden in welche Richtung sich ein Objekt bewegt.

Dies kann für einen vorausberechnenden Autofokus benutzt werden und damit der Nachteil des reinen Kontrastautofokus, der dies nicht vermag, aufgehoben werden.

Es düfte daher kein Zufalls sein, dass die Panasonic mFT Kameras, im Gegensatz zu anderen Fimren, keine Phasenkontrast-Pixel besitzen. Der neue Sensor macht diese Technik dann nämlich obsolet.

Der Global Shutter kann dann je nach vorhandener Rechengeschwindigkeit enorm hohe Serienbildraten ermöglichen. D. h. die Spiegel-Farktion kann sich schon mal warm anziehen, denn die Mechanik hat ausgeklappert.

Dem Spiegel

als solchem weint eh niemand nach. Der Verlust des optischen Suchers hingegen wäre ein schmerzhafter. Weswegen sich SLR neu erfinden muss, oder die Fotografie eine öde wird.

mehre Möglichkeiten

http://www.fotomagazin.de/technik/panasonic-stellt-cmos-sensoren-mit-organischem-film-aussicht

wie im Fotomagazin abgebildet, kann auch ein Sensor mit 100 – facher Empfindlichkeit gegenüber der heutigen CMOS-Technologie hergestellt werden, indem (siehe Abbildung) unterschiedlich empfindliche “Zellen” bereitgestellt und zusammen verrechnet werden.

Ich schätze mal, dass das, wie es so schön in Neudeutsch heisst, ein game changer gibt.

Definitiv!

Dass die s. g. organischen Sensoren mit einer fotosensitiven Schicht über kurz oder lang die reinen CMOS-Sensoren ablösen werden, ist ja schon lange klar. Dass bisher Metall die sensitive Schicht bildet, ist ohnehin eher ein eher alberner Anachronismus die noch aus der Zeit der Primitivsensoren für Belichtungsmesser stammt. Das CMOS-Plättchen ist ohnehin nur noch zur Auslesung der Impulse notwendig, wobei sich in einer weiteren Umdrehung ein integrierter Prozessor, der direkt die Daten verarbeitet, anbietet.

Seit die Smartphonetechnik auch sehr hohe Bildverarbeitungsgeschwindigkeiten beherrscht, kann auch die Kameratechnik davon massiv profitieren. Vorher war allein das notwendige rasante Auslesen der Sensordaten überhaupt nicht gegeben.

Also, ein Game Changer steht tatsächlich vor der Tür und Zeit wirds.

Na ja …

wenn ich mir die Bildqualität ansehe – und ich gehe davon aus, dass hier das zur Zeit unter optimalen Bedingungen mögliche und dann noch geschönte Resultat präsentiert wird …

http://www.fujirumors.com/assets/asdasdsdasd.jpg

dann haben sie noch einige Jährchen Arbeit vor sich, bis ich interessiert bin.

Ausserdem mißtraue ich den porganischen Kunststoff-Folien (OPF) von Grund auf. Das ist nichts richtig solides, nur flüchtige Kohlenwasserstoffe. Es geht nix über Silizium. Diese Plastikfolien sind nur suspekt. Nach 20 überbelichteten Blitzaufnahmen oder nach 3 jahren fängst das Zeuig an, sich aufzulösen. Und bei einer Langzeitbelichtung brennt sich das Bild in die ominöse OPF Folie ein. Aber sicher ganz im Sinne der herstellerseitig wünschenswerten geplanten Obsoleszenz.

Was mir wirklich gefällt, ist global shutter. Solid state. Ende Gelände für den Mechanik-Verschluss. Kein Geräusch mehr, keine Vibration mehr, 19. Jahrhundert endlich überwunden. Und dazu noch X-Sync gleich minimaler Verschlusszeit. Das muss aber auch mit einem richtigen Silizium-Sensor vernünftig möglich sein.

Flüchtig

Wie sonst sollte man den gemeinen Konsumenten dazu anhalten, zukünftig alle paar Monate den Sensor, also die Kamera, zu wechseln … die Fotoindustrie arbeitet halt an neuen Geschäftsmodellen, und die Behaltefrist für digitales Zeuchs ist inzwischen – mehrere Jahre! – eindeutig zu lang. :-)))

Gast schrieb:

Ausserdem

[quote=Gast]

Ausserdem mißtraue ich den porganischen Kunststoff-Folien (OPF) von Grund auf. Das ist nichts richtig solides, nur flüchtige Kohlenwasserstoffe. Es geht nix über Silizium. Diese Plastikfolien sind nur suspekt. Nach 20 überbelichteten Blitzaufnahmen oder nach 3 jahren fängst das Zeuig an, sich aufzulösen. Und bei einer Langzeitbelichtung brennt sich das Bild in die ominöse OPF Folie ein. Aber sicher ganz im Sinne der herstellerseitig wünschenswerten geplanten Obsoleszenz. [/quote]

Genau! Und wohin dann mit dem ganzen Müll? In den gelben Sack? Die Meere sind voll davon! Womöglich wird hier einfachste Frischhaltefolie verwendet!

[quote=Gast]

Was mir wirklich gefällt, ist global shutter. [/quote]

Endlich kann ich das globale Foto aufnehmen! Alles auf einmal! Wahnsinn!

Der Spaniel. Wau!

Das mit der Folie

ist alles andere als neu.

In der Autoindustrie werden schon seit langem Halbleiterfolien verwendet, für die Beleuchtung von Autoräumen beispielsweise oder Displays.

Es gibt inzwischen praktisch für jeden Zweck extrem haltbare und äußerst dünne Folien, die “dotiert” werden können. So dürfte es auch keine großen Probleme bei der Haltbarkeit dieser Folien geben. Außerdem kann man einen Sensor auch austauschen, was bei Foliensensoren sicher nicht mehr so gravierend ist, weil der Prozess an sich nicht mehr die Präzision erforderlich macht, wie das noch bei den geäzten Sensoren notwendig ist. Im Grunde ist der CMOS im Hintergrund, soweit ich das verstanden habe, eigentlich auch nicht mehr wirklich notwendig, aber die Fabs wollen ja beschäftigt werden.

Auf längere Frist werden sich die Foliensensoren durchsetzen, schon allein deshalb, weil die Fertigung nicht mehr in einer Fab im üblichen, aufwändigen CMOS-Prozess stattfindet, sondern sehr viel kostengünstiger über Folienbeschichtung. Dann spielt auch die eigentliche Sensorgröße nicht mehr die große Rolle (es lohnt sich u. U., seine alte MF-Ausrüstung weiter aufzuheben). Die Frage ist nur, wann der erste Hersteller für solche Sensorfolien die Fertigung aufnimmt und damit die anderen Hersteller zwingt, die alten CMOS-Fabs aufs Altenteil zu schicken.

photoscala schrieb:

Das

[quote=photoscala]Das einzelne Filmbild wird nicht auf einen Schlag belichtet, sondern zeilenweise – ganz gleich ob mit einem rotierenden Verschluss auf Film belichtet wird oder ein CMOS-Sensor aufnimmt. Bewegt sich nun ein Objekt schnell durchs Bild, wird es verzerrt aufgenommen.[/quote]

Ich gehe nicht zu Veteranentreffen, schon gar nicht zur Karnevalszeit, sonst hätte ich diesen Artikel samt Diskussion zur Büttenrede mitgenommen. Köstlich was es in der Vergangenheit alles gab, was wir damals gar nicht mitbekommen haben.

Ich kann jetzt unmöglich auf alles eingehen, aber einen Punkt kann ich schon heraus greifen:

“Das einzelne Filmbild wird nicht auf einen Schlag belichtet, sondern zeilenweise – ganz gleich ob mit einem rotierenden Verschluss auf Film belichtet wird …”

Sorry, ab hier war der Kaffee in der Tastatur. Einen Film zeilenweise zu belichten geht nur über einen Laserbelichter, welcher dazu dient, Videosignale auf Film zu belichten. Eine Technik, welche dort zur Anwendung kommt, wo noch echter Film in den Kinoprojektor gefädelt werden soll. Kein Rolling Shutter Effekt, weil ja hier ein im Computer (oder früher auf Band) gespeichertes Bild geschrieben wird.

Das Problem der Gestaltverzerrung bei Film gibt es trotzden auf sehr alten Fotos, welche damals mit Kameras mit Schlitzverschluss bei kurzen Belichtungszeiten aufgenommen wurden. Die frühen Verschlüsse waren relativ langsam und bei kurzen Zeiten lief ein Belichtungsschlitz über das Bildfenster, welcher zu ähnlichen Ergebnissen führte wie heute der Rolling Shutter.

Filmkameras hatten immer schon eine rotierende Sektorenblende, welche bei einer Umdrehung das Filmfenster zweimal für die Belichtung frei gab. Während der Dunkelphase wurde der Film um ein Kader weiter transportiert.

Frühe professionelle Videokameras hatten das Problem nicht. Damals in den späten 70er bis frühen 80er Jahren waren die CCD Chips (CMOS kam Jahrzehnte später) zweigeteilt. Eine Hälfte war lichtempfindlich, die zweite abgedunkelt. Nach der Belichtung wurde die Ladung in den abgedunkelten Bereich transferiert und dort zeilenweise ausgelesen. Um zu verhindern, dass während des Verschiebens die Belichtung weiter lief und der Bildinhalt verschmiert wurde, kam die gute alte Sektorenblende aus der Filmkamera zu Einsatz. Das Videobild wurde damit wie bei Film im Stück belichtet. Das zeilenweise Auslesen erfolgte damit nicht wie bei CMOS aus einem Livebild, sondern aus der Kopie im dunkeln Bereich des CCD, also einem Standbild. Damit war der Rolling Shutter Effekt unbekannt. Diese Technik wurde haupsächlich von BTS eingesetzt (Broadcast Television Systems, ein Gemeinschaftsunternehmen von Bosch und Philips, welche damals die Könige in der europäischen Videotechnik waren). Die Technik mit dem doppelten CCD und der mechanischen Sektorenblende war aber natürlich ein Blocker bei der Entwicklung kleinerer und letztlich amateurtauglicher Videokameras, sodass sehr bald bessere Lösungen nachfolgten. Die erste CCD Videokamera von Hitachi kam etwa um 1984, da hatte man die Sektorenblende längst vergessen.

Vergleich

Es gibt mittlerweile selbstfahrende Autos. Trotzdem würde ich mir immer wieder einen alten Landrover kaufen!

Selbstfahrende Autos

sind wie fotografierende Drohnen … freudelos und spaßbefreit. :-)))

Silizium und die Grenze

Licht kann wellenlängenabhängig bis zu einer gewissen Tiefe in Silizium eindringen und mit einer gewissen Wahrscheinlichkeit dort elektrische Vorgänge auslösen. Um diese Parameter kommt man nicht herum und sie begrenzen die Fähigkeiten von Bildsensoren. Viele der Fortschritte der letzten Jahre sind gar keine richtigen, sondern einfach verschobene Kompromisse. Wenn man die Farbfilter dünner und “breiter” (Frequenz) macht, steigt die Lichtempfindlichkeit, dafür sinkt die dann die Farbtrennung und der Gamut. usw. Es ist ja bezeichnend, dass die beiden interessantesten Sensoren im Kino-Bereich, der Alev III von Arri und der Ex-Kodak CCD-Chip in der Digital Bolex seit 2010 bzw. 2009 hergestellt werden.

Erst eine andere Oberfläche, die mehr Elektroden im Verhältnis zum Rauschen erzeugen/speichern kann, wird hier die Technik vorantreiben, und es könnte ja sein, dass das jetzt diese neue Technik ist. Bin jedenfalls gespannt.

Thyl

(5. Captcha)

Genauso hemmend

erweisen sich unzureichende Aufzeichnungs- bzw. Ausgabealgorithmen. Auf der heutigen Jpeg-Basis sind auch zukünftige Sensoren dazu verdammt, Kontraste und Farben auf einer unzureichenden Zahlenbasis zu codieren und dementsprechend eingeschränkt darstellen zu können.

Zitat:

“Der größte Vorteil

Zitat:

“Der größte Vorteil ergibt sich allerdings daraus, dass beim OPF-Sensor die photoelektrische Schicht und die Schaltkreise zum Speichern der elektrischen Ladung völlig unabhängig voneinander sind. Das ermöglich es, jedes Pixel einzeln anzusteuern und damit auch ein- und auszuschalten.”

Hhmm

Das Ansteuern der Pixel, das selbst auch Rauschen erzeugt, bleibt dabei allerdings erhalten.

Ehrlich gesagt, verstehe ich nicht, was gemeint ist mit der Unabhängigkeit von fotoelektrischer Schicht und Schaltkreise zum Speichern der Ladung (Ladung wird in Kapazitäten gesammelt und der Ladungszustand (über die Höhe der Spannung) abgefragt).

Wie soll denn dann noch die Ladung einem konkreten Pixel zugeordnet werden, wenn es diese Zuordnung bezüglich der photoelektrischen Schicht, also der Ladungsquelle nicht mehr gibt?

Gibt es dazu auch Veröffentlichungen in wissenschaftlichen Fachzeitschriften?

Ich fürchte, über diese Technologie wird man noch viele Jahre Artikel in den Laienblättern lesen können. Das fällt unter Werbung (für Fördergelder?).

MfG

Die Laiin

Dann

sind Sie ja über viele Jahre bestens versorgt.